Із початком повномасштабної війни значно активізувався й інформаційний фронт. Кількість дезінформації про глобальну політику, внутрішні справи України та Росії збільшилася в рази. Це один із виявів гібридної війни, яку веде РФ. І оскільки кожен українець уже більш як пів року ледь не цілодобово моніторить перебіг подій у своїх смартфонах, «медіазагартованість» стає надважливою у протидії ворогу. Здатність розпізнавати й реагувати на фейки та дезінформацію — спосіб опору і знешкодження загарбницьких планів.

*

Матеріал містить посилання на російські сайти, переглянути їх можна за допомогою VPN.Разом із Gwara Media розповідаємо, як перевірити правдивість інформації в медіа. Всі приклади — справжні «вкиди» російських пропагандистів, із якими ми стикалися упродовж повномасштабної війни.

Переважно фейки поширюють через блоги (анонімні або сумнівного авторства), телеграм- та ютуб-канали, фейсбук-сторінки ботів і вайбер-чати. Так, за результатами дослідження Київського міжнародного інституту соціології на замовлення «ОПОРА», з 24 лютого 2022 року більшість українців дізнаються новини саме з вайбера й телеграму, причому останній у травні став найпопулярнішим. 76,6 % респондентів спершу помічали новину в месенджері, а вже потім знаходили або не знаходили її у знайомих ЗМІ та на ТБ.

Популярність месенджерів і соцмереж як майданчиків для новин пояснити просто: для користувачів вони безкоштовні, прості й інтуїтивні у використанні, а для медіа — доступні платформи, щоб доставити повідомлення користувачам за лічені секунди. Тож це ідеальне середовище для поширення фейків, що можуть не лише спотворювати картину світу, а й безпосередньо впливати на життя людей. Наприклад, змусивши когось прийняти невчасне рішення про евакуацію. Особливо це загострюється під час повномасштабної війни, коли люди через постійне емоційне перенапруження більш піддатливі до маніпуляцій. Саме тому так важливо вміти самостійно розпізнавати фейки.

На прикладі дезінформації періоду повномасштабної війни показуємо, як і за допомогою яких інструментів можна перевірити пост на правдивість.

Крок 1: Шукаємо першоджерела

Перше, на що варто звернути увагу — це тон і стиль повідомлення в каналі, чаті чи групі. Медійники з хорошою репутацією дотримуються журналістських стандартів і не вдаються до клікбейту, поширення неперевірених даних або ж емоційних переконань без доказів.

клікбейт

З англ. clickbait від click «клацання» та bait «наживка» — прийом, який полягає у створенні надмірно емоційного заголовка, що змушує читача клікнути на матеріал, щоб прочитати. Часто зміст новини не відповідає заголовку.

слайдшоу

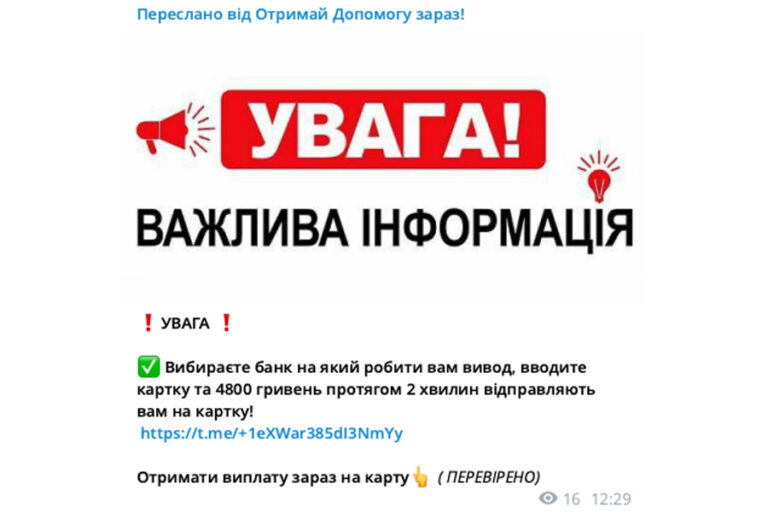

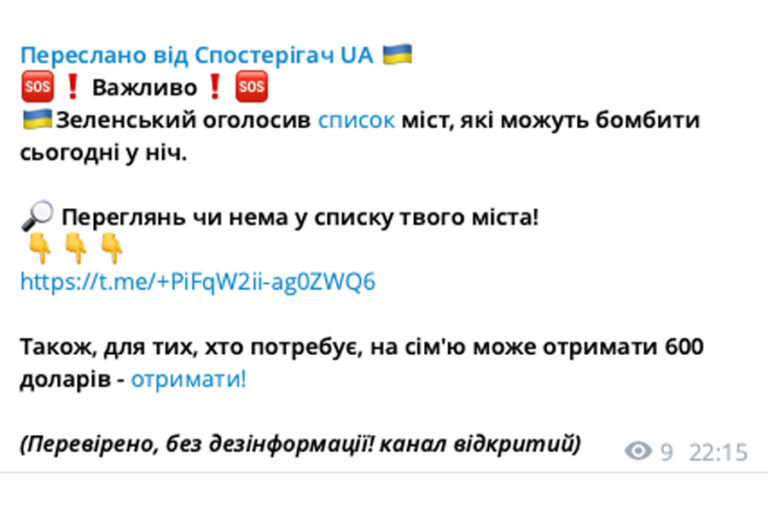

Трапилися повідомлення з емоційними фразами чи радикальними висловами? Якщо немає джерела інформації, не вказано автора коментаря чи в тексті посилаються на невідому особу («мій кум/ сват/ брат знає», «інформація ПЕРЕВІРЕНА»), а також закликають «максимально поширити новину» — найімовірніше, перед вами фейк. Часто такі повідомлення ще й містять забагато знаків оклику, знаків запитань чи емоджі.

Приклад фейку, який поширювали 28 лютого.

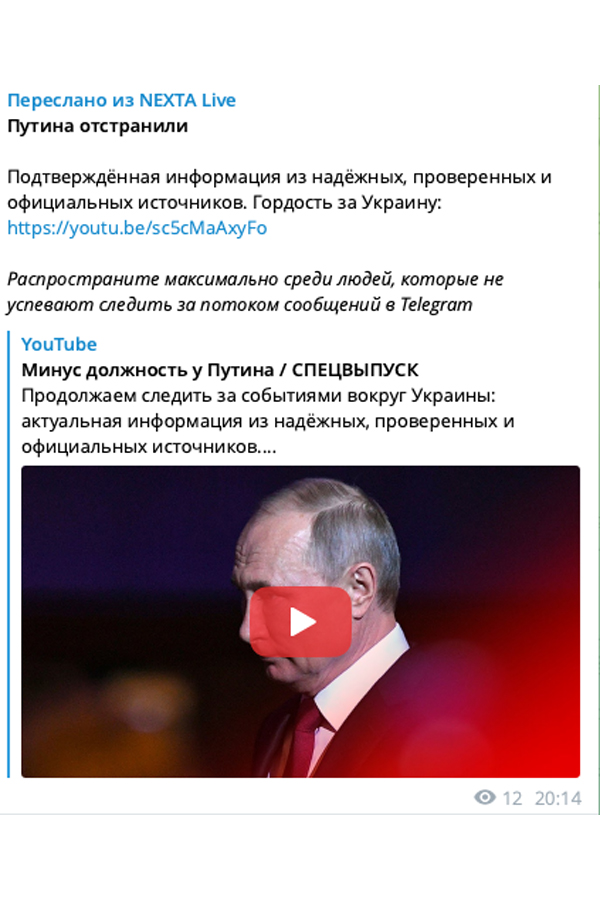

Буває й таке, що фейкомети приписують політикам чи громадським діячам вигадані або вирвані з контексту коментарі. Тоді потрібен даблчек, тобто подвійна перевірка. Повідомлення варто знайти на інших публічних акаунтах спікера. Якщо коментар більше ніде не з’являвся, крім як в анонімному чаті чи сумнівному телеграм-каналі, — це привід йому не довіряти.

Буває, що пропагандисти вигадують експерта, тобто додають до матеріалу коментар особи, якої насправді не існує.

Також трапляються перекручені чи навмисно неправильно перекладені слова, цитати з іноземних ЗМІ. В такому випадку варто розшукати першоджерело й перевірити текст оригінального повідомлення.

Часто викривленими подають не лише цитати, а й статистику. Так, скажімо, у червні російські медіа поширювали інформацію, нібито жителі тимчасово окупованих територій частини Приазов’я та Таврії вишиковуються в черги за російськими паспортами. Цю картину «масового попиту» сформували завдяки кільком десяткам людей, які частково добровільно, частково під примусом окупантів погодилися взяти документ станом на середину червня. Серед них були й відомі колаборанти. Однак після прочитання новини виникає логічне питання: чи може показник у 20–30 людей свідчити про масовий попит, коли населення обох областей за даними Держкомстату станом на початок 2022 року перевищувало 2,5 млн осіб? Навряд. Проте така псевдостатистика може стати основою для маніпулятивних заголовків новин.

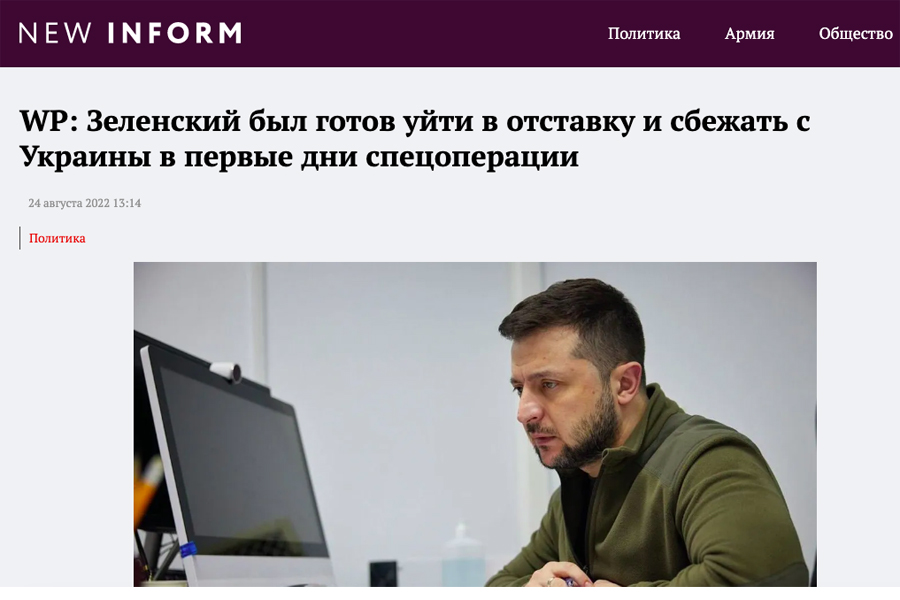

Приклад перекручування новин західних ЗМІ

Наприкінці серпня російське видання New Inform випустило новину з таким заголовком: «The Washington Post: Зеленский был готов уйти в отставку и сбежать из Украины в первые дни спецоперации». Новину також поширив російський Яндекс, RT, Газета.ру та десятки інших каналів. У ній стверджувалося, нібито журналісти The Washington Post з’ясували, що президент України збирався залишити країну напередодні воєнних дій. Насправді ж в оригінальній статті йдеться про те, що західні лідери просто радили Зеленському виїхати з Києва. Це — свідоме викривлення цитати. Так би мовити, труднощі перекладу по-російськи.

Приклад свідомо викривлених слів іноземних ЗМІ.

Крок 2: перевіряємо фото та документи

У соцмережах часто трапляються відредаговані фото та скан-копії документів. Психологія нашого сприйняття така, що коли ми бачимо поряд із текстом «фотопідтвердження», то свідомість автоматично маркує побачене як реальне й достовірне. Ідея перевірити інформацію може з’явитися (у кращому випадку) пізніше. Також не дуже втішні новини від дослідників: неозброєним оком люди все ж погано визначають, яке зображення оригінальне, а яке піддавали маніпуляціям. Ось чому важливо бути особливо уважним до зображень, які вам подають як «докази».

Найперше, що треба зробити — це придивитися уважніше до тексту відсканованого документа. Банальні граматичні помилки, неправильне відмінювання прізвищ, неповні назви організацій — все це може вказувати на фейк.

Є також кілька простих інструментів, які допоможуть виявити походження фото або ж наявність домальованих елементів без вивчення методик фотошопу.

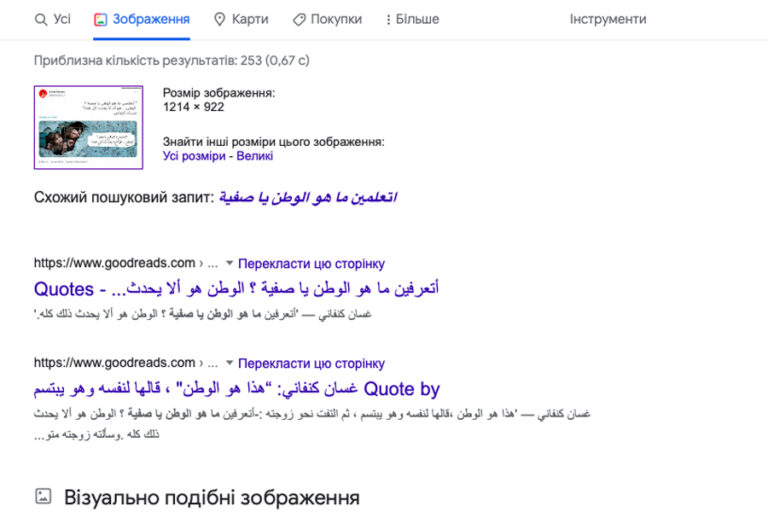

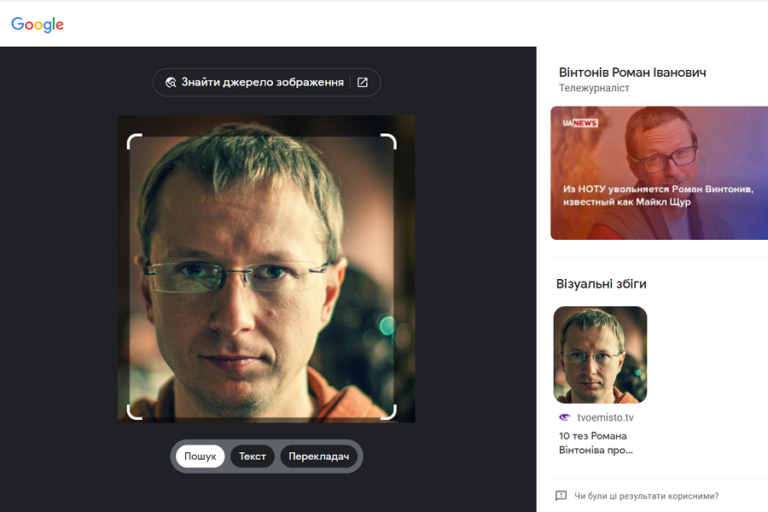

Перший із таких інструментів — це Google Images. У гугл є опція пошуку не лише за текстом, а й за зображеннями: обравши «Зображення» у верхньому меню та завантаживши файл, ви побачите, коли та де вперше з’явилося зображення.

Пошук за зображенням у гуглі.

Час від часу російські фейкороби кріплять фото з війн в інших країнах як доказ «злочинів» українських військових, звірств ЗСУ тощо. Здебільшого гугл пошук за зображенням уже допомагає відсіяти значну кількість фейкових повідомлень із соцмереж.

Приклад фейкового «фотодоказу»

Ще у 2021 році мережею ширилась інформація про вуличну виставку в Берліні з назвою «Детей Донбасса убила украинская армия». Журналісти «Радіо Свобода» довідалися, що фото нібито постраждалих дітей Донеччини, експоновані на вулицях міста, були взяті з різних джерел — таких, наприклад, як твіттер-акаунт сирійського поета.

слайдшоу

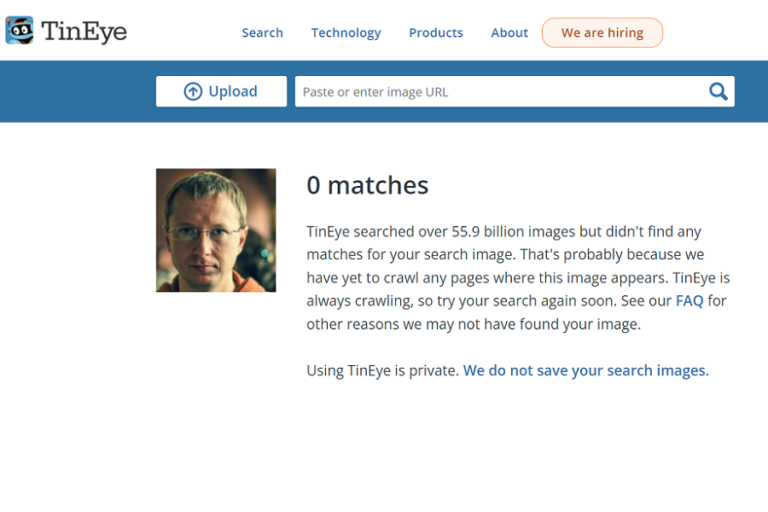

Не менш простий і зручний у користуванні пошуковик зображень — TinEye. Він допомагає не лише здійснити зворотний пошук зображення, тобто шукати сторінки, на яких ця картинка була опублікована раніше, а й відразу фільтрувати результати за такими параметрами:

– дата (найновіші чи найдавніші);

– розмір і вага файлу;

– кількість публікацій на тому чи тому сайті або домені.

Важливо, що сервіс TinEye дбає про приватність даних користувачів і не зберігає світлини, які вони завантажують для пошуку. Однак його недолік у тому, що він знаходить збіги зображень тільки в онлайн медіа. Тобто якщо ви хочете перевірити, скажімо, чи публікував хтось ваші світлини в соцмережах — це не вдасться, бо сервіс не показує результати соцмереж. Натомість гугл пошук за зображенням покаже всі візуальні збіги та джерела, де використано світлину.

слайдшоу

Дещо складніший інструмент — Forensically, що допомагає проаналізувати різні шари завантаженого зображення. Перевіривши картинку через Noise Analysis (аналіз шуму), Error Level Analysis (аналіз рівня помилок) чи Clone Detection (виявлення клонів), можна помітити втручання фоторедактора. Програма також показує метадані фото, тобто ключові технічні параметри — час, коли воно було зроблене, розміри, вагу файлу, характеристики камери, якою знімали зображення тощо.

Не так давно сервіс став широкодоступним. Українські фактчекери, що заснували сайт для перевірки фактів Stopfake.org, уже детально розповідали про особливості його використання.

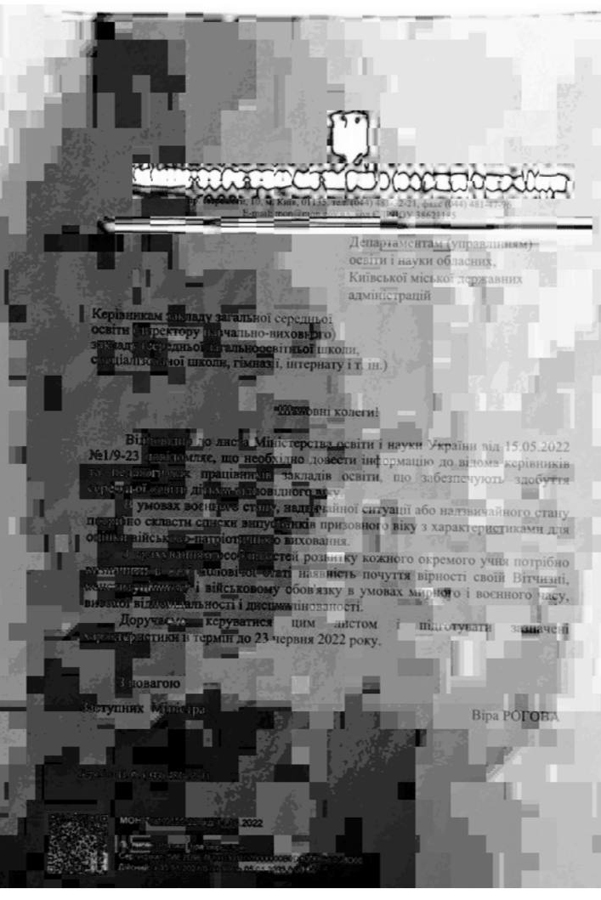

Один із найпростіших способів помітити домальовані деталі фото — застосувати опцію Noise Analysis. Якщо світлину не редагували, в цьому режимі на ньому не з’являться «биті» пікселі, занадто світлі або темні плями. Зображення буде рівномірно вкрите «шумами».

Приклад аналізу Forensically

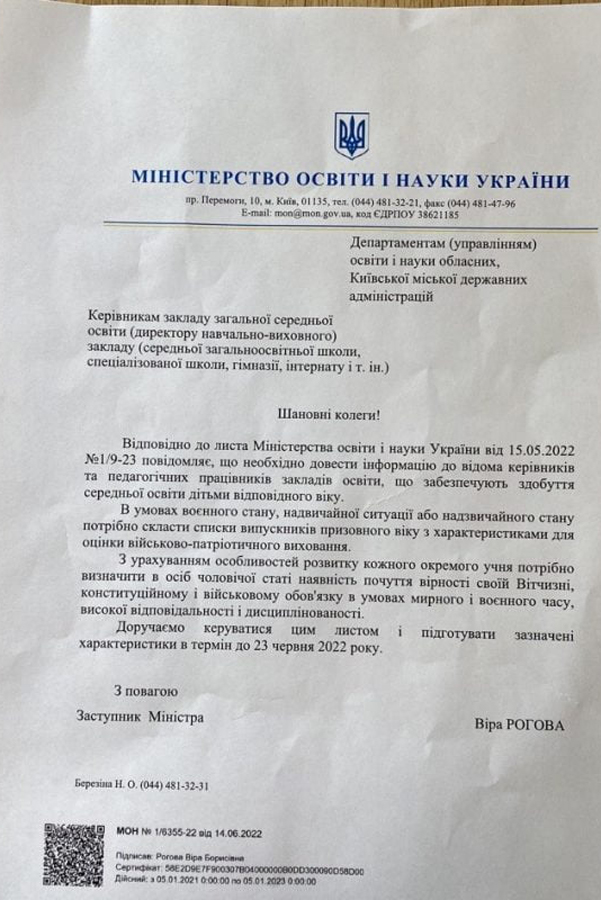

Влітку російський телеграм-канал Readovka запустив фейк про те, що українська влада нібито шукає школярів для служби в ЗСУ. На підтвердження цього, до поста прикріпили нібито офіційний лист від МОН, де стверджувалося: керівники навчальних закладів мають «скласти списки випускників призовного віку з характеристиками для оцінки військово-патріотичного виховання». Фактчекери Gwara Media перевірили цей «документ» через програму Forensically і побачили, що його створили у фоторедакторі.

Фото, що поширювали в мережі.

Його аналіз: видно, що «шапка» листа МОН узята з іншого файлу та накладена на оригінал фото.

Крок 3: перевіряємо відео

Із відео також варто бути уважними. Клікбейтний заголовок, який ви бачите на сайті, чи обкладинка на ютубі не завжди передають реальний зміст відеоматеріалу. Перш ніж довіряти інформації в тому вигляді, в якому її подає автор — перевірте інформацію про канал (коли з’явився, про що він, чи не є клоном оригінального ЗМІ), погляньте на дату завантаження в описі під самим відео, тобто під заголовком.

Навіть така проста перевірка інколи може допомогти розпізнати фейк.

Серед усіх різновидів дезінформації, найважче самостійно ідентифікувати так звані дипфейки. Це реалістичні відеоролики, створені програмним забезпеченням зі штучним інтелектом на основі синтезу фото та відео реальних осіб так, щоб виглядати автентичними. Один із найяскравіших прикладів — фейкове відео з нібито промовою Барака Обами 2018 року. На таких відео видно, як людина говорить, рухається, дивиться в камеру (в цьому випадку досить реалістично).

Для створення дипфейків використовують різні підходи:

– замінюють обличчя — створюють ніби цифрову маску, яку накладають на відео;

– клонують голос, щоб потім генерувати з нього потрібну звукову доріжку;

– синхронізують рухи губ так, щоб вони відповідали необхідній звуковій доріжці.

На щастя, створити дійсно якісний дипфейк не так просто, і деякі з них таки можна розпізнати неозброєним оком. В першу чергу, треба звертати увагу на такі деталі:

– Неприродність міміки. Якщо помічаєте, що під час розмови герой робить неприродні паузи, міміка сповільнена або пришвидшена — це може бути згенероване відео.

– Колір шкіри. Якщо вигляд шкіри обличчя не схожий на справжній (на тон темніший або світліший за інші частини тіла).

– Краї маски навколо обличчя. Їх можна помітити, збільшивши зображення.

– Спотворені контури тіла чи обличчя, що наче перекривають інші предмети в кадрі.

– Нечіткі риси обличчя, той час як інші предмети у фокусі та загалом відео має гарну якість.

– Нерегулярне моргання людини на відео. Технології створення дипфейків уже досить розвинені, але тут іще бувають огріхи, що видають підробку.

– Розсинхрон звуку і рухів губами. Актори дубляжу користуються поняттям ліпсинг (з англ. «lip» — губи й «sync» — синхронізація), тобто прийому, коли закадрова мова героя відповідає тому, як він рухає губами. Тож якщо ви переглядаєте відео мовою оригіналу і людина час від часу наче рухає губами невлад своїм словам — це ознака дипфейку.

– Похибки дипфейк-алгоритмів. Незвичні форми вух, зубів чи носа або, навпаки, ідеально симетричне обличчя; «клаптиковість» і нерівність шкіри та (або) волосся; невідповідні герою чи ситуації або неправдоподібні аксесуари (сережки, окуляри).

Приклад дипфейку

На початку повномасштабного вторгнення російські пропагандисти запустили відверто низькосортний дипфейк із Володимиром Зеленським. 16 березня хакери зламали етер телемарафону, де працювала команда «України 24», та в рухомому рядку запустили текст фейкового звернення президента до українців із проханням скласти зброю та не чинити опір. Дипфейк із цими ж закликами до капітуляції миттєво поширився мережею. Його вади помітити нескладно: обличчя президента непропорційне до тіла, яке залишається нерухомим протягом всього звернення; колір шиї та обличчя відрізняється, міміка — неприродна.

Телемарафон

Багатогодинна або багатоденна телевізійна безперервна трансляція з благодійною, політичною або іншою метою. Український інформаційний телемарафон «Єдині новини» почав мовлення з 26 лютого для оперативного висвітлення новин і запобігання російській пропаганді.У березні, після численних скарг, компанія Meta видалила ролик зі своїх платформ.

Скрин із фейкового відео, де президент закликав скласти зброю.

Крок 4: звертаємося до фактчекерів

Якщо ж вам складно самостійно розібратися, чи фейкове перед вами повідомлення, — надішліть його фактчекерам. У перші дні повномасштабної війни команда Gwara Media створила телеграм-, а згодом і вайбер-бот «ПЕРЕВІРКА», куди користувачі можуть надіслати будь-яку новину, щоб протягом доби дізнатися її фейк-статус. Бот сповістить вас про рівень правдивості надісланої інформації — «правда», «фейк», «маніпуляція», «недостатньо доказів» або надасть розгорнутий коментар.

Підписавшись на бот, ви також отримуватимете щоденний дайджест фейків і резонансних маніпуляцій, що ширяться мережею.

Фактчек-бот «ПЕРЕВІРКА» рекомендували Центр протидії дезінформації при РНБО, Інститут масової інформації, Мінцифри України, «Інтерньюз Україна» та низка ОДА. Його мета — надавати чіткі й оперативні відповіді на запити людей.

Новини в боті перевіряє не алгоритм, а професійні фактчекери та журналісти. Надіслати ж інформацію на перевірку можна в будь-якому вигляді: як текст, лінк на пост, фото чи відео. Ще одна мета проєкту — навчити якомога більшу кількість користувачів соцмереж розпізнавати фейки самостійно, тому в розділі «Фейкотня» можна знайти аналітичні й освітні матеріали. Із 24 лютого фактчекери «Перевірки» вже обробили 50 211 запитів, з яких 8 517 виявилися фейками — про найпоширеніші з них за період з травень по липень 2022 можна почитати в матеріалі Gwara Media.

Також в Україні є громадські організації, що регулярно займаються аналітикою, наприклад, StopFake. Ця організація заснована ще у 2014 році, після тимчасової окупації Криму та вторгнення РФ на схід України, щоб боротись з російськими фейками. Фактчекери регулярно розбирають найбільш віральні й небезпечні випадки дезінформації.

Вартий уваги і проєкт «Антологія брехні» від VoxCheck: на платформі можна знайти фейки, згруповані за різними темами, сферами суспільного життя чи ті, що стосуються різних політиків. Це допоможе зрозуміти, наскільки варто довіряти висловам того чи того експерта, депутата чи лідера думок.

Як прокачати вміння розпізнавати фейки?

Ось кілька інструментів, за допомогою яких можна визначити свій поточний рівень медіаграмотності та потренуватися розпізнавати фейки.

Тест від проєкту «Фільтр»

Національний проєкт із медіаграмотності, запущений Мінкультом, пропонує тест на чутливість до маніпуляцій і «натреноване око». Допоможе оцінити рівень вміння розпізнавати фейки.

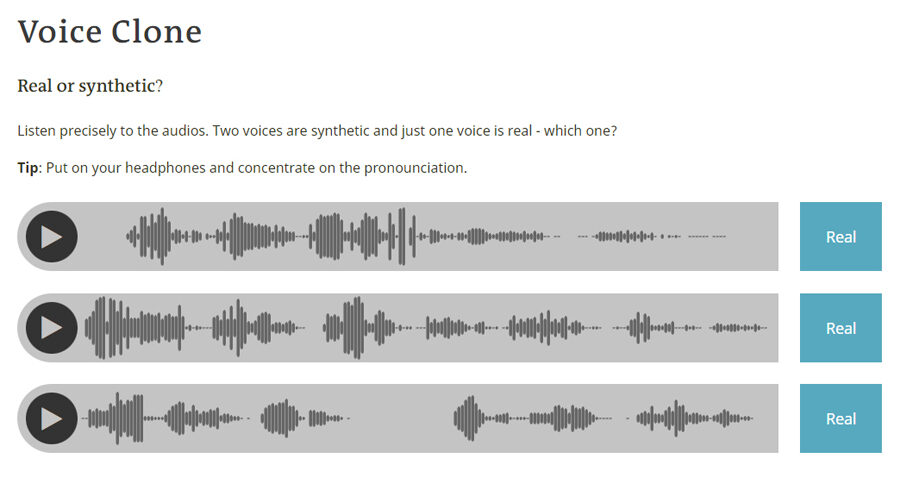

Digger Project

Платформа, що тренує зорові та слухові навички для розпізнавання фейків. Перевірте, наскільки ви уважні до деталей на майже ідентичних фото та чи можете почути різницю у схожих голосах.

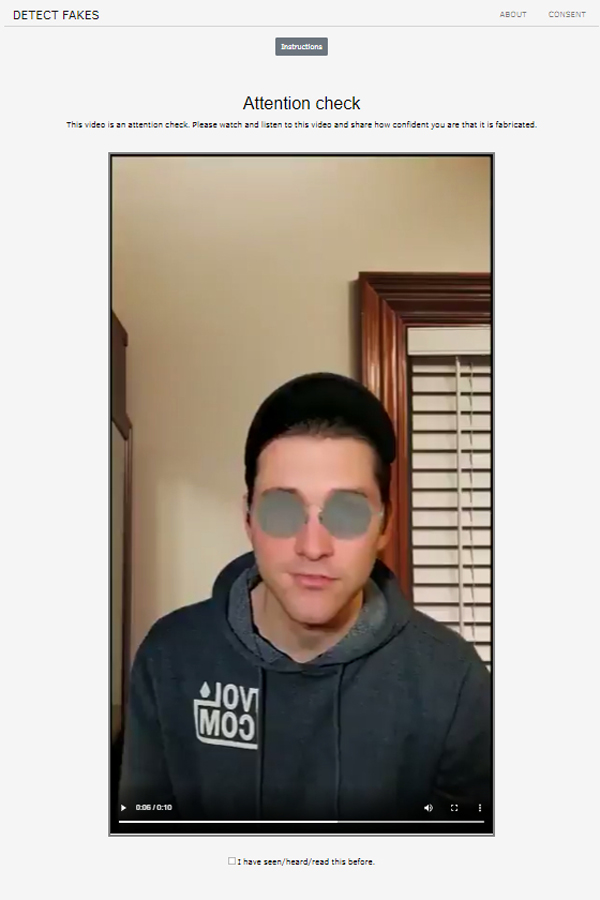

Detect Fakes

Тест, завдяки якому можна перевірити, чи здатні ви розпізнати сфабриковане відео й аудіозапис. Правильні відповіді ви побачите в кінці.

This person does not exist

Платформа, що показує неймовірно реалістичні фото людей, яких не існує. Портрети, створені нейромережею, з’являються щоразу, коли ви заходите на платформу.

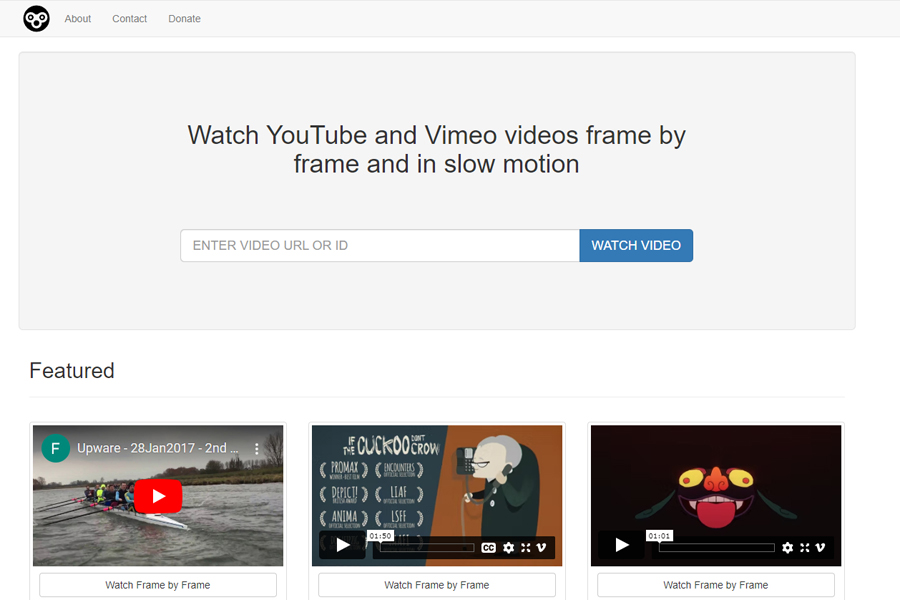

Watch frame by frame

Вебсайт для покадрового перегляду відео, що допомагає краще та швидше виявляти дипфейки.

Botometer

Проєкт, що допомагає перевіряти справжність твіттер-акаунтів, а отже, захищає від ботів.

Повномасштабна війна в Україні ще раз показала, наскільки важливо вміти фільтрувати інформацію та проводити якісний фактчекінг. Адже на її перебіг впливають не тільки здобутки на фронті, а й користувачі соцмереж, медійники, громадські аналітики й розслідувачі. Тож важливо відповідально ставитися до всього контенту — і того, який ми споживаємо, і який поширюємо.